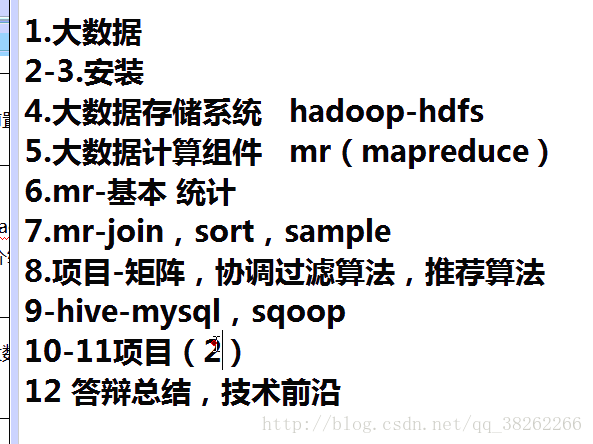

本文共 3288 字,大约阅读时间需要 10 分钟。

1、什么是大数据?特点?

大数据(:Big data),又称为巨量资料,指的是传统数据处理应用软件不足以处理它们的大或复杂的数据集的术语。在总数据量相同的情况下,与个别分析独立的(Data set)相比,将各个小型数据集合并后进行分析可得出许多额外的信息和数据关系性,可用来察觉商业趋势、判定研究质量、避免疾病扩散、打击犯罪或测定即时交通路况等;这样的用途正是大型数据集盛行的原因。

“大数据”的经典定义是可以归纳为4个V:

海量的数据规模(volume)

快速的数据流转和动态的数据体系(velocity)

多样的数据类型(variety)

巨大的数据价值(value)

2、数据仓库

,英文名称为Data Warehouse,可简写为或DWH。数据仓库,是为所有级别的决策制定过程,提供所有类型数据支持的战略。它是单个数据存储,出于分析性报告和决策支持目的而创建。 为需要业务智能的企业,提供指导业务流程改进、监视时间、成本、质量以及控制。

3、数据挖掘DataMine和数据分析ExtractTransformLoad的区别是什么?

- 数据量上:数据分析的数据量可能并不大,而数据挖掘的数据量极大。

- 约束上:数据分析是从一个假设出发,需要自行建立方程或模型来与假设吻合,而数据挖掘不需要假设,可以自动建立方程。

- 对象上:数据分析往往是针对数字化的数据,而数据挖掘能够采用不同类型的数据,比如声音,文本等。

- 结果上:数据分析对结果进行解释,呈现出有效信息,数据挖掘的结果不容易解释,对信息进行价值评估,着眼于预测未来,并提出决策性建议。

数据分析是把数据变成信息的工具,数据挖掘是把信息变成认知的工具,如果我们想要从数据中提取一定的规律(即认知)往往需要数据分析和数据挖掘结合使用。举个例子说明:你揣着50元去菜市场买菜,对于琳琅满目的鸡鸭鱼猪肉以及各类蔬菜,想荤素搭配,你逐一询问价格,不断进行统计分析,能各自买到多少肉,多少菜,大概能吃多久,心里得出一组信息,这就是数据分析。而关系到你做出选择的时候就需要对这些信息进行价值评估,根据自己的偏好,营养价值,科学的搭配,用餐时间计划,最有性价比的组合等等,对这些信息进行价值化分析,最终确定一个购买方案,这就是数据挖掘。 数据分析与数据挖掘的结合最终才能落地,将数据的有用性发挥到极致。

4、hadoop小飞象

是一个由Apache基金会所开发的基础架构。

用户可以在不了解分布式底层细节的情况下,开发分布式程序。充分利用集群的威力进行高速运算和存储。

Hadoop实现了一个(Hadoop Distributed File System),简称HDFS。HDFS有高的特点,并且设计用来部署在低廉的(low-cost)硬件上;而且它提供高吞吐量(high throughput)来访问的数据,适合那些有着超大数据集(large data set)的应用程序。HDFS放宽了(relax)POSIX的要求,可以以流的形式访问(streaming access)文件系统中的数据。

Hadoop的框架最核心的设计就是:HDFS和MapReduce。HDFS为海量的数据提供了存储,则MapReduce为海量的数据提供了计算。

5、ubuntu-java安装配置

1.安装JDK

我们可以使用两种方法安装JDK,一种是在线安装。另一种是先下载JDK安装包然后再离线安装。在线安装:执行命令$ sudo apt-get install jdk

离线安装:下载jdk-7u75-linux-x64.tar.gz,下载路径:

http://www.oracle.com/technetwork/java/javase/downloads/jdk7-downloads-1880260.html 把离线包拷入到ubuntu的当前用户hadoop的文件夹下,然后执行命令安装。 执行命令(解压修改名称)$cd /home/hadoop/ $tar -zxvf jdk-7u75-linux-x64.tar.gz $mv jdk1.7.0_75 jdk1.7 mv是名称修改2.配置JDK环境变量

安装完jdk后,需要配置环境变量,把java变成系统内命令

编辑/etc/profile文件来修改系统环境变量。 执行命令$ sudo gedit /etc/profile 打开/etc/profile文件在文件中添加如下配置(前后均不能有空格,否则配置出错)export JAVA_HOME=/home/ hadoop/ jdk1.8 进入jdk文件夹,pwd目录复制粘贴到此 export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar 不用改 export PATH=$PATH:$JAVA_HOME/bin 不用改 export JRE_HOME=$JAVA_HOME/jre 不用改 使profile文件修改配置生效 执行命令$ source /etc/profile $ java -version 如果出现java version "1.8.0_45"

Java(TM) SE Runtime Environment (build 1.8.0_45-b14)

Java HotSpot(TM) 64-Bit Server VM (build 25.45-b02, mixed mode)则成功

6、hadoop安装配置

hadoop下载解压过程同java

修改hadoop环境变量配置

执行命令 $sudo gedit /etc/profile 进入/etc/profile修改配置export HADOOP_HOME=/home/hadoop/hadoop-2.6.0 (进入hadoop目录pwd复制粘贴至此)

使hadoop命令配置生效

执行命令source /etc/profile编辑hadoop-env.sh文件,修改参数信息

执行命令 $cd hadoop-2.6.0/ etc/hadoop $sudo gedit hadoop-env.sh export JAVA_HOME=/home/hadoop/jdk1.7export PATH=.:$HADOOP_HOME/bin:$JAVA_HOME/bin:$PATH(以防出错,修改java命令)这句话在/etc/profile进行PATH替换

执行hadoop version命令查看是否成功

Hadoop 2.7.1

Subversion https://git-wip-us.apache.org/repos/asf/hadoop.git -r 15ecc87ccf4a0228f35af08fc56de536e6ce657a Compiled by jenkins on 2015-06-29T06:04Z Compiled with protoc 2.5.0 From source with checksum fc0a1a23fc1868e4d5ee7fa2b28a58a This command was run using /home/alice/hadoop/hadoop2.7/share/hadoop/common/hadoop-common-2.7.1.jar转载地址:https://bupt-xbz.blog.csdn.net/article/details/79131914 如侵犯您的版权,请留言回复原文章的地址,我们会给您删除此文章,给您带来不便请您谅解!

发表评论

最新留言

关于作者